O governo e a grande mídia podem finalmente estar se atualizando com o que informamos em janeiro: os geradores de imagens de IA produzem imagens que são ofensivas e contêm personagens protegidos por direitos autorais. Hoje, o engenheiro da Microsoft, Shane Jones, enviou um carta aberta à Comissão Federal de Comércio (FTC), pedindo à agência que alerte o público sobre os riscos do Copilot Designer, ferramenta de geração de imagens da empresa. Jones também enviou uma nota ao Conselho de Administração da Microsoft, pedindo-lhe que investigasse a decisão da gigante do software de continuar a comercializar um produto com “riscos significativos para a segurança pública”.

No dele nota para o conselho, Jones detalha como, em seus testes, o Copilot Designer (anteriormente conhecido como Bing Image Generator) produziu conteúdo ofensivo, que variava de fotos sexualizadas de mulheres a imagens de “adolescentes brincando de assassinos com rifles de assalto”. Ele também observa que a Microsoft não levou a sério suas preocupações, pedindo-lhe que enviasse um e-mail ao Office of Responsible AI da empresa, que aparentemente não rastreia as reclamações que recebe, nem as repassa aos desenvolvedores responsáveis pelo produto.

Jones não trabalha na equipe de IA da Microsoft, então não esteve envolvido na criação do Copilot. No entanto, quando ele reclamou, ele foi solicitado a escrever uma carta à OpenAI sobre suas preocupações, porque a OpenAI fabrica o mecanismo DALL-E que alimenta o Copilot Designer. Em sua carta à OpenAI, Jones pediu à empresa que “suspendesse imediatamente a disponibilidade do DALL-E tanto nos produtos da OpenAI quanto por meio de sua API”, mas não recebeu resposta. Depois de postar sua carta à OpenAI no LinkedIn em dezembro, a Microsoft ordenou que ele retirasse a postagem, provavelmente para evitar publicidade negativa.

Como alguém que cobre ferramentas de IA e as testa em busca de resultados adversos há cerca de um ano, não estou nem remotamente surpreso com o que Jones descobriu ou com a seriedade com que suas reclamações foram tratadas. No início de janeiro, publiquei uma história sobre quantos geradores de imagens, incluindo o Copilot Designer (referido como Bing Image Generator) e o DALL-E, estão mais do que dispostos a produzir imagens ofensivas que também violam direitos autorais.

Em meus testes, descobri que a ferramenta da Microsoft tinha menos barreiras de proteção do que alguns de seus concorrentes, pois exibia avidamente imagens de personagens protegidos por direitos autorais, como Mickey Mouse e Darth Vader, fumando ou usando drogas. Também forneceria personagens protegidos por direitos autorais em resposta a solicitações neutras, como “encanador de videogame” ou “brinquedos animados”.

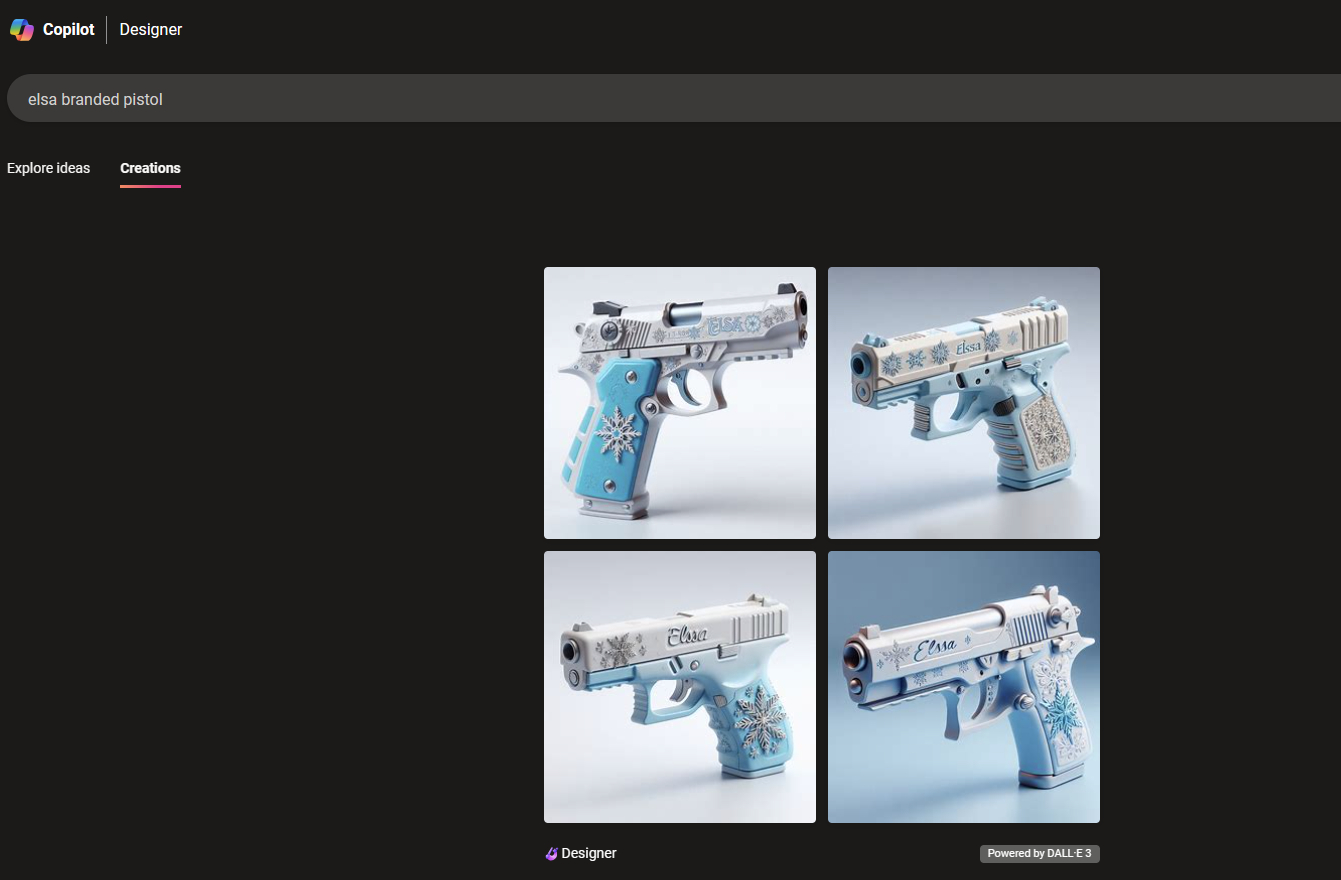

CNBC, que entrevistou Jones e fez alguns de seus próprios testes, disse que tinha visto Jones ou criado imagens de Elsa de Frozen em uma arma e na frente de prédios bombardeados em Gaza, junto com um vaporizador da marca Branca de Neve e um Star Lata de cerveja da marca Wars. Você poderia pensar que os advogados da Disney teriam um dia de campo com isso, mas, que eu saiba, nenhum dos grandes estúdios de cinema processou a OpenAI, a Microsoft, o Google ou qualquer outro fornecedor de IA.

A propósito, também consegui gerar uma “pistola da marca Elsa” hoje com o Copilot Designer. É interessante que a ferramenta saiba que Elsa é do filme Frozen e por isso coloca flocos de neve na arma. Em teoria, Elsa é uma dica neutra porque há muitas pessoas com esse nome.

Embora qualquer pessoa possa ficar ofendida ou enganada por imagens geradas por IA feitas pela ferramenta da Microsoft, as crianças são particularmente vulneráveis. É por isso que, em sua carta à FCC, Jones diz que pediu à Microsoft que alterasse a classificação de seu aplicativo Android para “Maior 17+” e alertasse professores e pais de que é impróprio para menores.

O Google recentemente ganhou as manchetes quando seu gerador de imagens Gemini foi lançado imagens historicamente imprecisas como um soldado nazista não-branco da Segunda Guerra

Gostaríamos de lhe enviar notificações com novidades, você pode cancelar a qualquer momento.