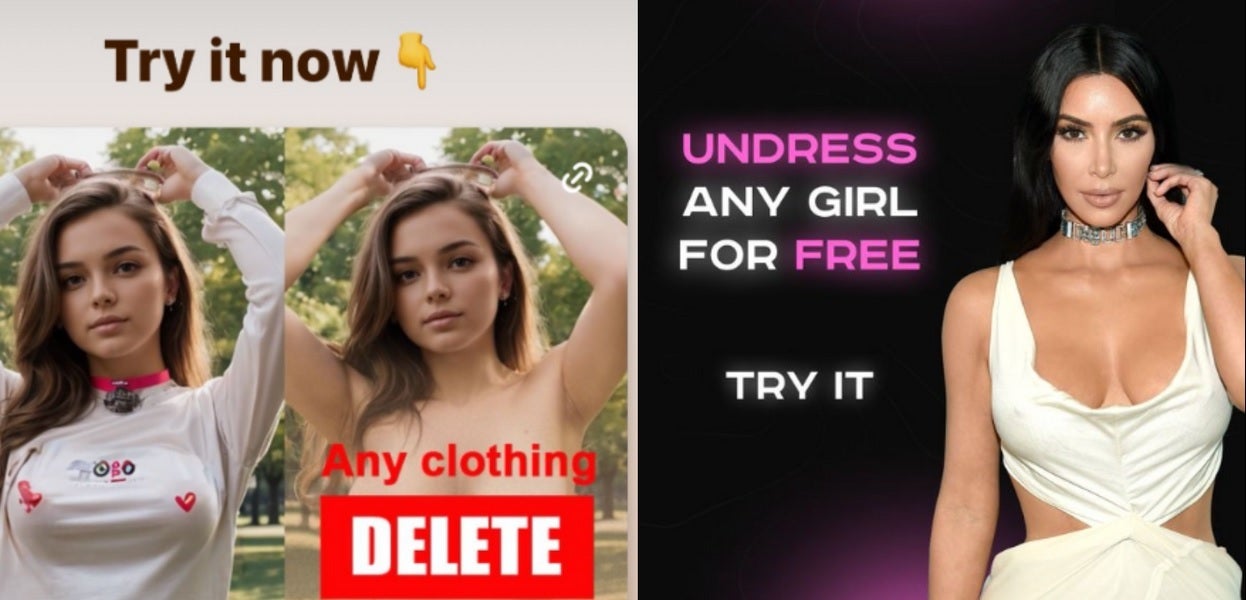

Esses aplicativos foram descritos pela App Store como “geradores de arte”, embora o que eles realmente fizeram foi criar “imagens de nudez não consensuais”. Essas imagens não mostram realmente como essas mulheres realmente são sem roupas e dependem da IA para criar o que parece ser o corpo nu sob as roupas. No entanto, estas fotografias ainda podem ser utilizadas para envergonhar ou humilhar as mulheres e chantageá-las.

A 404 Media disse que a Apple removeu os aplicativos, mas não antes de fornecer ao gigante da tecnologia links para os aplicativos e seus anúncios. O relatório sugeria que a Apple não conseguia encontrar os aplicativos ofensivos sozinha. Embora alguns desses aplicativos oferecessem o recurso de “despir” da IA, outros realizavam trocas de rosto em imagens adultas.

Aplicativos removidos da App Store pela Apple anunciavam no Instagram e em sites adultos sobre a capacidade de seu aplicativo de criar pornografia

Alguns desses aplicativos começaram a aparecer na App Store já em 2022 e pareciam inocentes para a Apple e o Google, pois os aplicativos estavam listados na App Store e na Play Store, respectivamente. Aparentemente sem o conhecimento das empresas de tecnologia, os desenvolvedores por trás desses aplicativos anunciavam seus recursos pornográficos em sites adultos. Em vez de retirar imediatamente esses aplicativos do ar, a Apple e o Google permitiram que eles permanecessem em suas lojas de aplicativos desde que parassem de anunciar em sites pornográficos.

Apesar da demanda da Apple e do Google, um dos aplicativos não parou de anunciar em sites adultos até este ano, quando o Google retirou o aplicativo da Play Store.