O que você precisa saber

- A TIME detalhou como uma empresa de São Francisco chamada Sama ajudou a construir um sistema de segurança para o ChatGPT.

- Os funcionários da Sama, com sede no Quênia, supostamente ganhavam cerca de US$ 1,32 e US$ 2 por hora, dependendo da antiguidade e do desempenho.

- Sama foi posteriormente encarregado de rotular imagens explícitas para um projeto desconhecido da OpenAI, mas depois desistiu do contrato devido a questões de legalidade e rompeu os laços com a OpenAI.

- A história continua a destacar o impacto humano por trás da nascente revolução da IA.

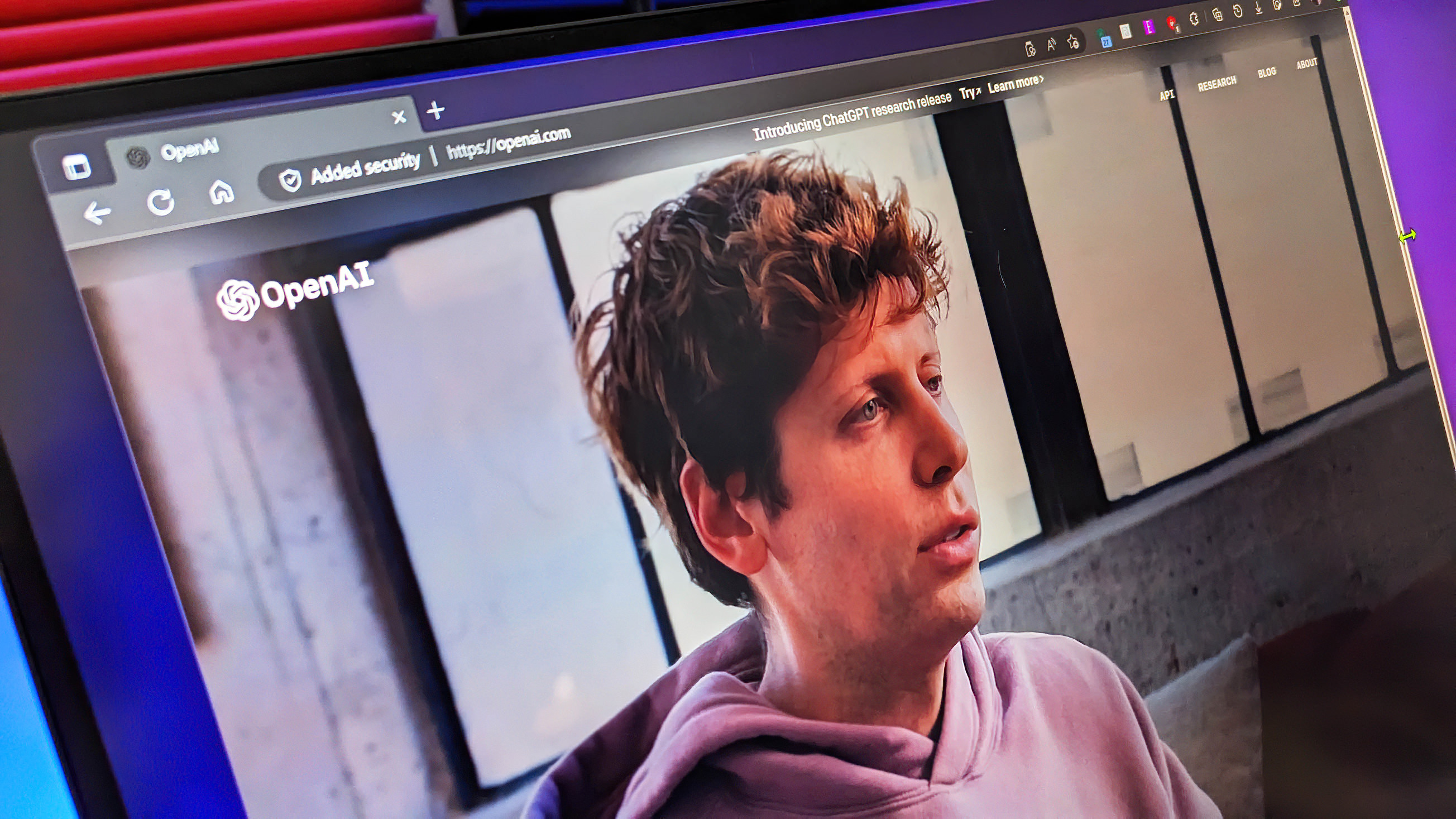

Em uma história complicada de tempos, trabalho entre a OpenAI, a empresa por trás do ChatGPT, e a Sana, uma empresa sediada em San Francisco que emprega pessoas no Quênia chamadas Sama. Sama trabalha com algumas das maiores empresas do setor de tecnologia, incluindo Google, Meta e Microsoft, na rotulagem de conteúdo em imagens e texto para conteúdo explícito.

A Microsoft já investiu US$ 1 bilhão na OpenAI, com possíveis US$ 10 bilhões a mais a caminho. A Microsoft planeja colocar IA em tudo e alavancar o ChatGPT com o Bing.

A Sama tem sede em San Fran, mas o trabalho é feito por trabalhadores do Quênia, ganhando cerca de US$ 1,32 e US$ 2 por hora. Infelizmente, para manter o ChatGPT “seguro” para os usuários, o OpenAI precisa alimentá-lo com muitos dados da Internet, que não são filtrados. Portanto, em vez de usar humanos para filtrar todas as coisas ruins, a OpenAI (e empresas como a Meta com o Facebook) emprega outras ferramentas de IA para remover esse conteúdo do pool de dados automaticamente.

Mas, para treinar essas ferramentas de segurança, são necessários humanos para indexar e rotular o conteúdo.

Como o História de 2019 no Facebook de The Vergeque destacou o impacto psicológico de tal conteúdo sobre os trabalhadores, os funcionários da Sama também tiveram destino semelhante:

“Um funcionário da Sama encarregado de ler e rotular o texto da OpenAI disse à TIME que teve visões recorrentes depois de ler uma descrição gráfica de um homem fazendo sexo com um cachorro na presença de uma criança. “Isso foi uma tortura”, disse ele. “Você vai ler uma série de declarações como essa durante toda a semana. Quando chega a sexta-feira, você fica perturbado por pensar naquela imagem. A natureza traumática do trabalho acabou levando a Sama a cancelar todo o seu trabalho para a OpenAI em fevereiro de 2022, oito meses antes do planejado.”

O contrato geral com a Sama era de $ 200.000, e esse contrato estipulava que pagaria “uma taxa horária de $ 12,50 para a Sama pelo trabalho, que era entre seis e nove vezes o valor que os funcionários da Sama no projeto estavam levando para casa por hora”.

Mais tarde, Sama começou a pilotar um novo projeto para OpenAI não relacionado ao ChatGPT. No entanto, em vez de texto desta vez, eram imagens, incluindo algumas ilegais sob a lei dos EUA, como abuso sexual infantil, bestialidade, estupro, escravidão sexual e morte e violência. Mais uma vez, os trabalhadores deveriam visualizar e rotular o conteúdo para que os sistemas da OpenAI pudessem filtrar essas coisas.

Sama, porém, cancelou todo o trabalho com a OpenAI logo em seguida. A empresa diz que fez isso por preocupação com o conteúdo (e questões legais). No entanto, os funcionários foram informados de que a investigação anterior da TIME sobre Sama e Facebook, onde funcionários quenianos foram usados como moderadores, levou à reviravolta devido às más relações públicas que a empresa estava recebendo.

Claro, enquanto Sama está fora de cena para OpenAI, o trabalho deve continuar, e não está claro quem mais está fazendo isso.

Tomada do Windows Central

A história de Sama, infelizmente, não é incomum. A moderação de conteúdo no Facebook também enfrentou reclamações semelhantes há alguns anos, onde os moderadores tinham que ver imagens horríveis diariamente para removê-las do site. O objetivo, é claro, não é submeter os humanos a esse tipo de conteúdo e fazer com que a IA e o aprendizado de máquina (ML) o façam – mas, para treinar esses sistemas, os humanos precisam fazer parte da rotulagem inicial dos dados.

A outra questão é o foco na remuneração. Enquanto US$ 1,32 é terrível para qualquer um em um mercado industrializado, para aqueles em economias emergentes como o Quênia, é bastante decente, caindo em torno do nível salarial de uma secretária ou professor. A TIME até observa como, embora a Sama tenha cortado os laços com a OpenAI, seus funcionários ficaram sem emprego. Do mesmo artigo:

“… disse um funcionário da Sama nos projetos de rotulagem de texto. “Respondemos que, para nós, era uma forma de sustentar nossas famílias.” A maioria das cerca de três dúzias de trabalhadores foi movida para outros fluxos de trabalho com salários mais baixos sem o bônus de conteúdo explícito de $ 70 por mês; outros perderam seus empregos. A Sama entregou seu último lote de dados rotulados para a OpenAI em março, oito meses antes do término do contrato.”

Então, a questão corta nos dois sentidos. Por um lado, nenhum ser humano deveria ter que ver tal conteúdo diariamente (mesmo que a Sama afirme que recursos psicológicos foram oferecidos aos funcionários); por outro, algumas pessoas preferem fazer esse trabalho a nada.

A questão mais significativa é que não está claro qual é a alternativa para tudo isso se a IA tiver um futuro. Infelizmente, pelo menos inicialmente, os humanos precisam fazer parte desse processo de treinamento. Ainda assim, o impacto nesses indivíduos (e na sociedade em geral) é algo que não pode ser medido. ou ignorado.