Com o crescimento maciço de ChatGPT fazendo manchetes todos os dias, o Google e a Microsoft responderam exibindo chatbots de IA integrados em seus mecanismos de pesquisa. É evidente que a IA é o futuro. Mas o futuro de quê?

Na Tom’s Hardware, queremos ultrapassar os limites da tecnologia para ver o que é possível, então, em um nível técnico, estou impressionado com a aparência humana das respostas do chatbot. A IA é uma ferramenta poderosa que pode ser usada para aprimorar o aprendizado humano, a produtividade e a diversão. Mas tanto o bot Bard do Google quanto o chatbot “Novo Bing” da Microsoft são baseados em uma premissa falha e perigosa: que os leitores não se importam de onde vêm suas informações e quem está por trás delas.

Construídos com base em informações de autores humanos, os mecanismos de IA de ambas as empresas estão sendo posicionados como alternativas aos artigos com os quais aprenderam. O resultado final pode ser uma web mais fechada, com menos informações gratuitas e menos especialistas para lhe oferecer bons conselhos.

O Google demonstrou Bard em um tweet e em um evento transmitido ao vivo, onde forneceu não apenas respostas factuais, mas também recomendações. A empresa ficou constrangida quando descobriu que uma das respostas de Bard estava incorreta, mas os problemas com Bard e o Novo Bing vão muito além da imprecisão.

Dando conselhos, sem o conselheiro

No evento ao vivo, Google SVP Prabhakar Raghavan disse que Bard era uma boa escolha para responder a perguntas que ele categorizou como NORA (No One Right Answer). “Para perguntas como essas, provavelmente queremos explorar uma gama diversificada de opiniões ou perspectivas e estar conectados à vastidão da sabedoria da web”, disse ele. “Novos recursos de IA generativa nos ajudarão a organizar informações complexas e vários pontos de vista diretamente nos resultados da pesquisa.”

A “expansão da web” na verdade significa que o bot está se apropriando de dados de milhões de artigos que foram escritos por humanos que não são creditados nem compensados por seu trabalho. Mas você não saberia nada disso vendo a saída de Bard.

Raghavan mostrou o Google respondendo “quais são as melhores constelações para procurar ao observar as estrelas?” Em vez de mostrar os melhores artigos da web sobre esse tópico, o mecanismo de pesquisa exibe seu próprio miniartigo com seu próprio conjunto de constelações recomendadas. Não há citações para dizer de onde vieram esses “múltiplos pontos de vista”, nem há autoridade para apoiar as afirmações que ele faz.

Bard diz: “Existem muitas constelações que você pode procurar na próxima vez que observar as estrelas. Aqui estão alguns populares.” Como sabemos que são populares e como sabemos que são as melhores constelações? Com autoridade de quem o bot está dizendo isso? Aparentemente, devemos apenas confiar nele.

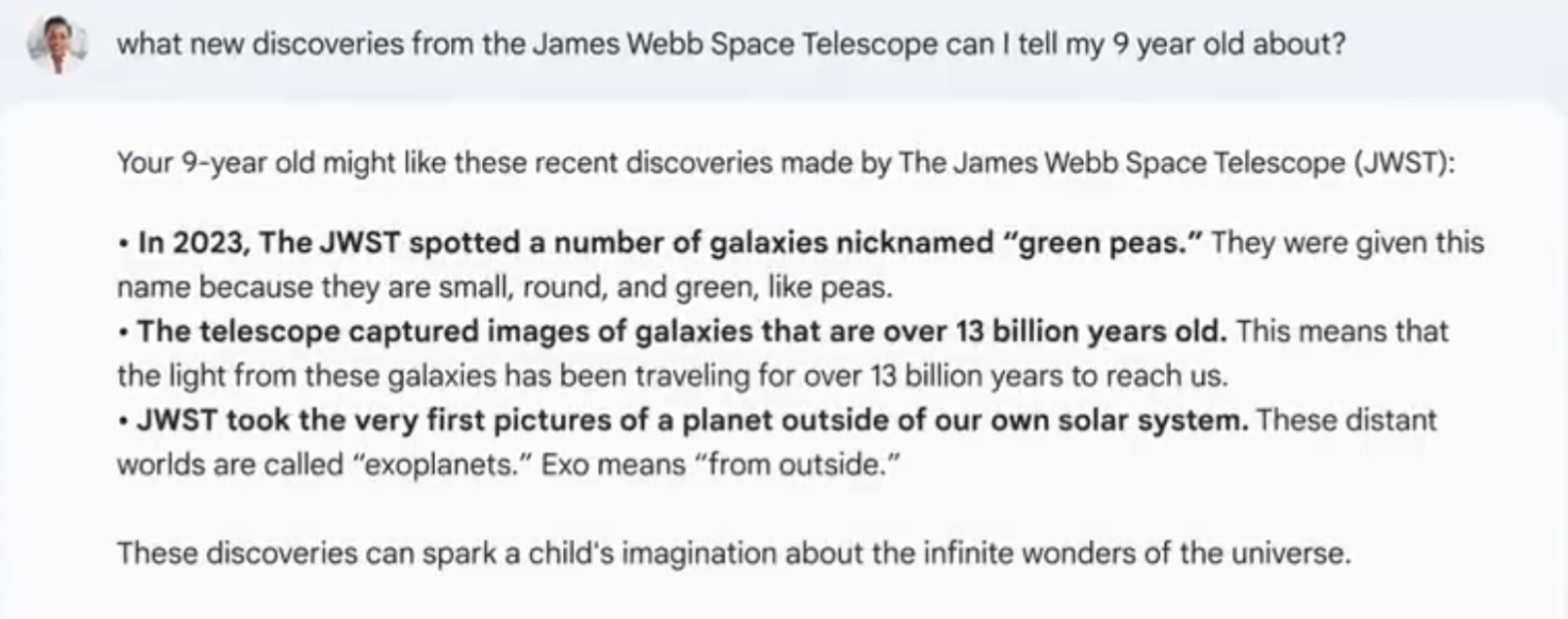

Mas a confiança é difícil de encontrar. O tweet da empresa mostrou uma situação embaraçosa onde Bard dá uma lista de “novas descobertas” do Telescópio Espacial James Webb (JWST), mas um dos três pontos não é realmente uma nova descoberta. De acordo com NASAas primeiras fotos de um exoplaneta foram tiradas em 2004, muito antes do lançamento do JWST em 2021.

Muitos críticos estarão justificadamente preocupados com possíveis imprecisões factuais nos resultados do chatbot, mas provavelmente podemos supor que, à medida que a tecnologia melhorar, ela ficará melhor na eliminação de erros. O problema maior é que os bots estão lhe dando conselhos que parecem vir do nada – embora tenham sido obviamente compilados pegando conteúdo de escritores humanos a quem Bard nem mesmo está creditando.

Desvalorização da experiência, autoridade e confiança

Ironicamente, a iniciativa do Google vai contra os principais critérios que a empresa diz priorizar na classificação de buscas orgânicas. A empresa aconselha os editores da web que considera EEAT (Experiência, Expertise, Autoridade e Confiança) quando decide quais artigos estão no topo de uma página e quais aparecem na parte inferior. Leva em consideração critérios como a formação do autor, se ele descreve experiências relevantes e se a publicação tem reputação de ser confiável. Por definição, um bot não pode atender a nenhum desses critérios.

Quando não há uma resposta certa, é quando o conteúdo humano é mais importante. Queremos conselhos de uma fonte confiável, alguém com experiência no assunto e um conjunto de opiniões profissionais com base na experiência.

Se conhecermos o autor, podemos fazer julgamentos sobre a confiabilidade da informação. É por isso que, quando vou a reuniões familiares, os parentes me abordam e fazem perguntas como “que laptop devo comprar?” Eles poderiam apenas fazer uma pesquisa na web para essa pergunta (e talvez devessem), mas eles me conhecem e acreditam que não os orientarei errado.

O Google espera que, em um mundo onde todos têm uma opinião e se expressam nas mídias sociais, a experiência não seja mais importante para os usuários. A empresa espera que você apenas leia o que vê na parte superior da tela, acredite tanto quanto em qualquer outra coisa e depois permaneça no site para poder continuar visualizando seus anúncios, uma fonte de receita, ininterruptamente. Se você sair do mecanismo de pesquisa, estará no site de outra pessoa, onde o Google pode ou não ser responsável por veicular os anúncios.

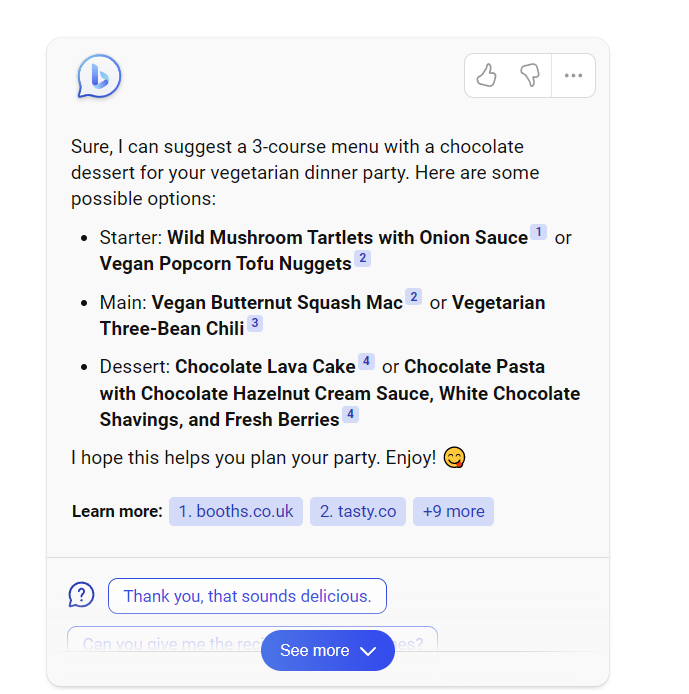

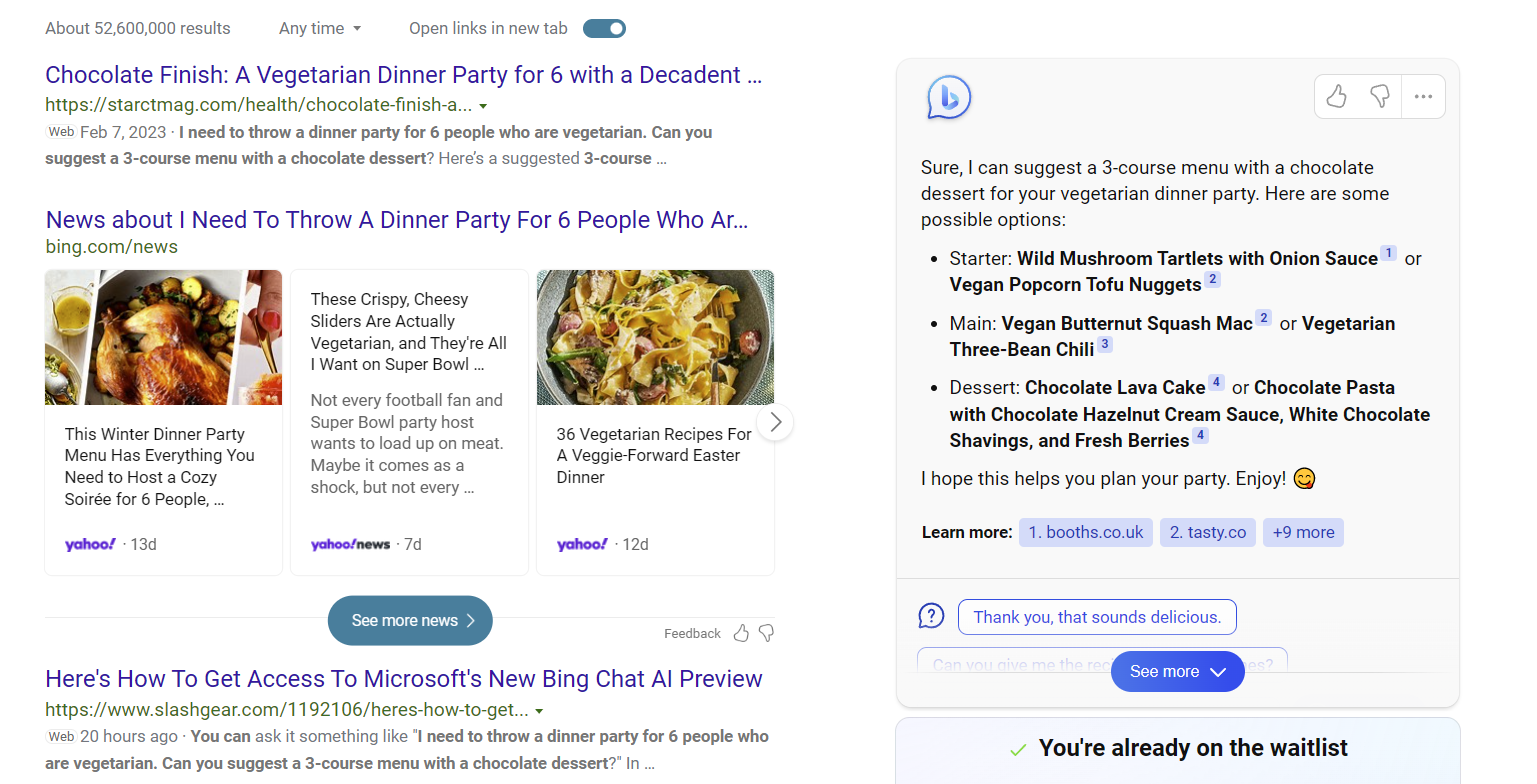

Bing mostra fontes, mas as enterra

A nova implementação do chatbot do Bing é um pouco melhor do que a do Google, pois na verdade mostra as fontes, mas as enterra em pequenas notas de rodapé, algumas das quais nem são visíveis, a menos que você clique em um botão para expandir a resposta.

Mesmo que as citações no chatbot do Bing fossem mais proeminentes, ele ainda oferece conselhos que seria melhor recebermos de uma pessoa com experiência. No exemplo acima, o bot prepara um jantar vegetariano de três pratos com uma sobremesa de chocolate. Mas como sei que essas são as melhores receitas ou que a harmonização desses pratos é boa?

Prefiro confiar no principal resultado da pesquisa, que foi escrito por um humano que já cozinhou antes e pensou sobre esse conjunto de pratos como uma pessoa faria. Para crédito do Bing, porém, ele coloca seu próprio conteúdo ao lado dos resultados da pesquisa orgânica, em vez de empurrá-los para baixo.

Você pode argumentar que os tópicos de demonstração que o Google e a Microsoft escolheram são altamente subjetivos. Algumas pessoas pensarão que Orion é a melhor constelação para se observar, enquanto outras escolherão a Ursa Maior. E é exatamente por isso que o autor importa.

Somos todos guiados por nossos preconceitos e, em vez de tentar escondê-los, os melhores autores os adotam e os divulgam. Se você leu algumas das minhas análises de laptops, sabe que a digitação por toque é importante para mim. Eu experimentei centenas de teclados de laptop em minha carreira; Posso dizer quais são moles e quais são táteis e rápidos. E o conforto do teclado será levado em consideração em minhas recomendações se você me perguntar quais modelos são os melhores. Se você não se importa com a qualidade do teclado ou gosta de teclas esponjosas, pode decidir dar menos peso às minhas classificações (ou a esse aspecto delas).

Não sabemos quais preconceitos estão por trás das listas de receitas, constelações ou qualquer outra coisa do bot. Os dados podem até ser extraídos de comerciais.

Bots de IA podem prejudicar a Web aberta

Admito outro viés. Sou um escritor profissional, e chatbots como os mostrados pelo Google e Bing são uma ameaça existencial para quem é pago por suas palavras. A maioria dos sites depende fortemente da pesquisa como fonte de tráfego e, sem esses globos oculares, o modelo de negócios de muitos editores está falido. Sem tráfego significa sem anúncios, sem cliques de comércio eletrônico, sem receita e sem empregos.

Eventualmente, alguns editores podem ser forçados a fechar as portas. Outros podem se esconder atrás de paywalls e outros ainda podem impedir que o Google e o Bing indexem seu conteúdo. Os bots de IA ficariam sem fontes de qualidade para coletar, tornando seus conselhos menos confiáveis. E os leitores teriam que pagar mais por conteúdo de qualidade ou se contentar com menos vozes.

Ao mesmo tempo, está claro que esses bots estão sendo treinados pela indexação do conteúdo de escritores humanos, muitos dos quais foram pagos por editores por seu trabalho. Então, quando o bot diz que Orion é uma ótima constelação para ver, é porque em algum momento ele visitou um site como nosso site irmão Space.com e coletou informações sobre constelações. Como os modelos foram treinados é uma caixa preta, então não sabemos quais sites exatos levaram a quais afirmações factuais, embora o Bing nos dê uma ideia com suas citações.

Se o que o Google e o Bing estão fazendo constitui plágio ou violação de direitos autorais está aberto à interpretação e pode ser determinado em tribunal. Atualmente, a Getty Images é processando a Stable Diffusion, empresa que gera imagens de IA, por usar 10 milhões de suas imagens para treinar o modelo. Posso imaginar uma grande editora seguindo o exemplo.

Alguns anos atrás, a Amazon era credivelmente acusado de copiar produtos de seus próprios vendedores terceirizados e, em seguida, fabricando seus próprios produtos da marca Amazon – que, sem surpresa, aparecem mais alto na pesquisa interna. Isso soa familiar.

Você poderia argumentar que o LaMDA do Google (que alimenta o Bard) e o mecanismo OpenAI do Bing estão fazendo a mesma coisa que um autor humano pode fazer. Eles estão lendo fontes primárias e, em seguida, resumindo-as em suas próprias palavras. Mas nenhum autor humano tem o tipo de poder de processamento ou base de conhecimento que essas IAs têm.

Você também pode argumentar que os editores precisam de uma fonte de tráfego melhor do que o Google – e nós precisamos, mas a maioria dos usuários foi treinada para tratar a pesquisa como sua primeira parada na Internet. Em 1997, as pessoas acessavam o Yahoo, navegavam em um diretório de sites, encontravam aqueles que correspondiam aos seus interesses, marcavam-nos como favoritos e voltavam novamente. Isso era muito parecido com o modelo de audiência para redes de TV, revistas e jornais, já que a maioria das pessoas tinha algumas fontes de informação preferidas nas quais confiariam regularmente.

Mas a maioria dos usuários da Internet foi treinada para acessar plataformas de distribuição como Google, Facebook e Twitter e navegar na web a partir daí. Você pode gostar e confiar em um editor, mas geralmente chega ao site desse editor encontrando-o no Google ou no Bing, que pode ser acessado diretamente na barra de endereços do navegador. Será difícil para qualquer editor ou mesmo grupo de editores mudar esse comportamento profundamente arraigado.

Mais importante, se você é um consumidor de informações, está sendo tratado como um bot, esperando que absorva informações sem se importar de onde elas vieram ou se você pode confiar nelas. Essa não é uma boa experiência do usuário.

Nota: Como acontece com todos os nossos artigos de opinião, as opiniões expressas aqui pertencem apenas ao escritor e não ao Tom’s Hardware como uma equipe.