A Nvidia acaba de publicar alguns novos números de desempenho para sua GPU de computação H100 em MLPerf 3.0, a versão mais recente de um benchmark proeminente para cargas de trabalho de aprendizado profundo. O processador Hopper H100 não apenas supera seu antecessor A100 em medições de tempo de treinamento, mas também está ganhando desempenho graças às otimizações de software. Além disso, a Nvidia também revelou as primeiras comparações de desempenho de sua GPU de computação compacta L4 com sua predecessora, a GPU T4.

A Nvidia publicou pela primeira vez os resultados do teste H100 obtidos no Benchmark MLPerf 2.1 em setembro de 2022, revelando que sua principal GPU de computação pode superar seu antecessor A100 em até 4,3–4,4 vezes em várias cargas de trabalho de inferência. Os números de desempenho recém-lançados obtidos no MLPerf 3.0 não apenas confirmam que o H100 da Nvidia é mais rápido que o A100 (sem surpresa), mas reafirma que também é tangivelmente mais rápido que o processador Xeon Platinum 8480+ (Sapphire Rapids) lançado recentemente pela Intel, bem como o processador NeuChips ReccAccel N3000 e soluções Cloud AI 100 da Qualcomm em uma série de cargas de trabalho

Essas cargas de trabalho incluem classificação de imagens (ResNet 50 v1.5), processamento de linguagem natural (BERT Large), reconhecimento de fala (RNN-T), imagens médicas (3D U-Net), detecção de objetos (RetinaNet) e recomendação (DLRM). A Nvidia afirma que não apenas suas GPUs são mais rápidas, mas também têm melhor suporte em todo o setor de ML – algumas das cargas de trabalho falharam em soluções concorrentes.

Há um problema com os números publicados pela Nvidia. Os fornecedores têm a opção de enviar seus resultados MLPerf em duas categorias: fechado e aberto. Na categoria fechada, todos os fornecedores devem executar redes neurais matematicamente equivalentes, enquanto na categoria aberta eles podem modificar as redes para otimizar seu desempenho para seu hardware. Os números da Nvidia refletem apenas a categoria fechada, portanto, as otimizações que a Intel ou outros fornecedores podem introduzir para otimizar o desempenho de seu hardware não são refletidas nos resultados desses grupos.

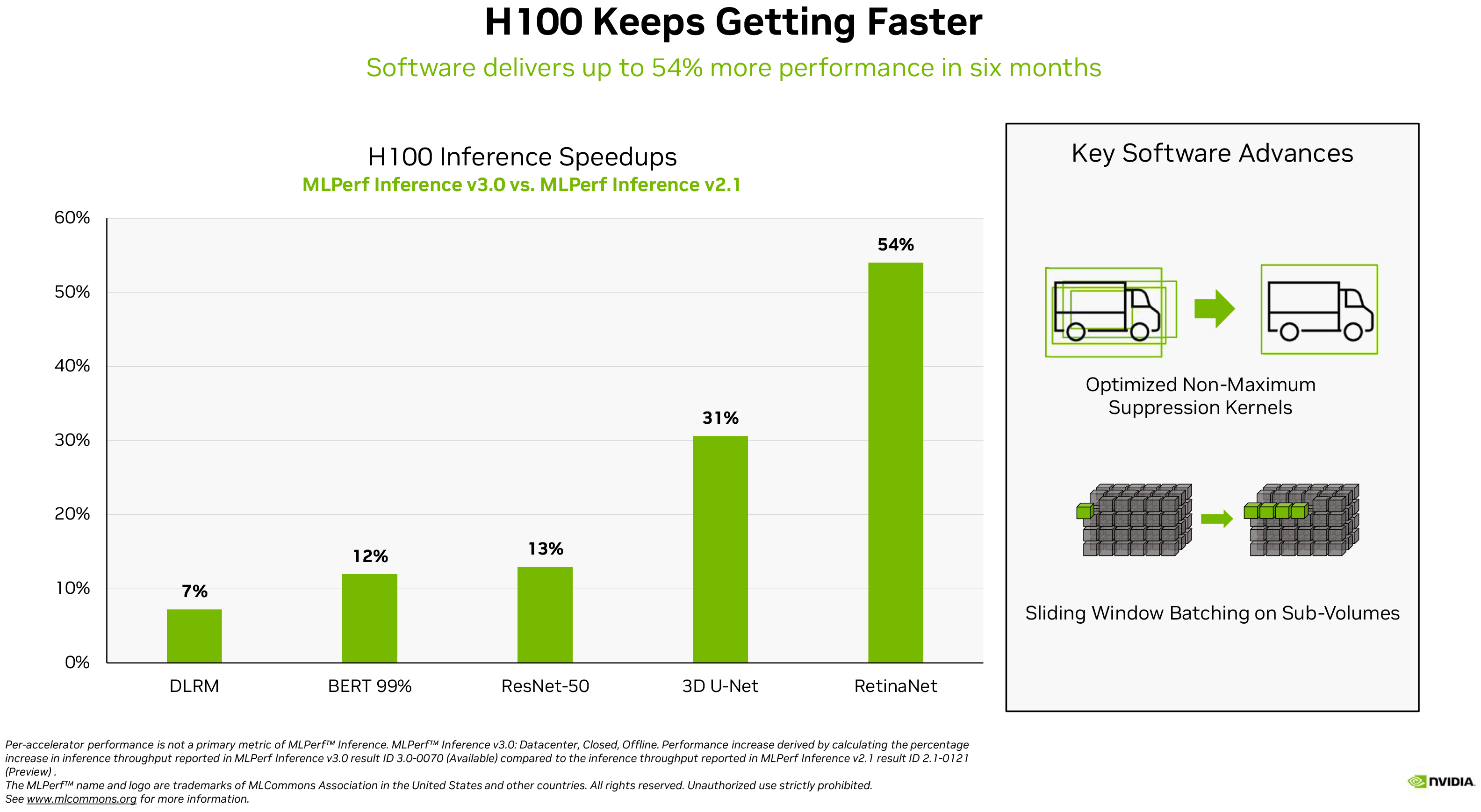

As otimizações de software podem trazer enormes benefícios para o hardware de IA moderno, como mostra o próprio exemplo da Nvidia. O H100 da empresa ganhou de 7% em cargas de trabalho de recomendação para 54% em cargas de trabalho de detecção de objetos com MLPerf 3.0 em comparação com MLPerf 2.1, o que é um aumento considerável de desempenho.

Referindo-se à explosão do ChatGPT e serviços similares, Dave Salvator, Diretor de IA, Benchmarking e Nuvem, da Nvidia, escreve em um post de blog: “Neste momento de IA do iPhone, o desempenho em inferência é vital… Deep Learning está sendo implantado em quase todos os lugares, gerando uma necessidade insaciável de desempenho de inferência, desde o chão de fábrica até os sistemas de recomendação on-line.”

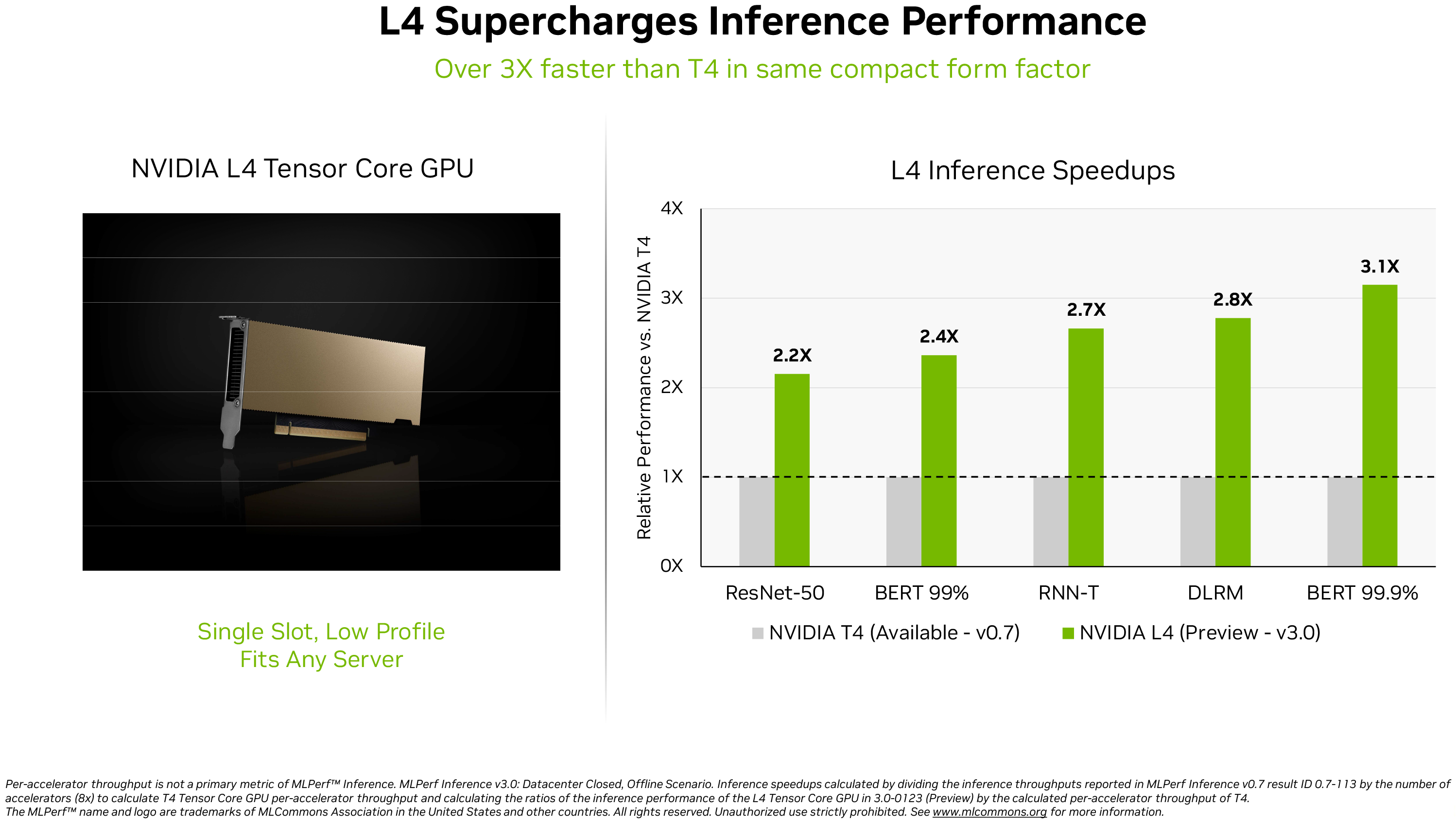

Além de reafirmar que seu H100 é o rei do desempenho de inferência no MLPerf 3.0, a empresa também deu uma espiada no desempenho de seu recém-lançado GPU de computação L4 baseada em AD104 (abre em nova aba). Esta placa GPU de computação com tecnologia Ada Lovelace vem em um fator de forma discreto de slot único para caber em qualquer servidor, mas oferece desempenho bastante formidável: até 30,3 FP32 TFLOPS para computação geral e até 485 FP8 TFLOPS (com esparsidade ).

A Nvidia apenas comparou seu L4 com uma de suas outras GPUs compactas de datacenter, o T4. Este último é baseado na GPU TU104 com a arquitetura Turing de 2018, então não é surpresa que a nova GPU seja 2,2–3,1 vezes mais rápida que a predecessora no MLPerf 3.0, dependendo da carga de trabalho.

“Além do desempenho estelar de IA, as GPUs L4 oferecem decodificação de imagem até 10x mais rápida, processamento de vídeo até 3,2x mais rápido e gráficos 4x mais rápidos e desempenho de renderização em tempo real”, escreveu Salvator.

Sem dúvida, os resultados de benchmark das GPUs de computação H100 e L4 da Nvidia – que já são oferecidos pelos principais fabricantes de sistemas e provedores de serviços em nuvem – parecem impressionantes. Ainda assim, lembre-se de que estamos lidando com números de referência publicados pela própria Nvidia, e não com testes independentes.