O que você precisa saber

- Um estudo de pesquisadores de Stanford mostra um declínio no desempenho do chatbot da OpenAI.

- Os pesquisadores usaram quatro indicadores-chave de desempenho para determinar se o GPT-4 e o GPT-3.5 estavam melhorando ou piorando.

- Ambos os LLMs exibem desempenho e comportamentos variados em diferentes categorias.

No início deste ano, as portas da IA generativa se abriram, trazendo uma nova realidade de oportunidades. O novo Bing da Microsoft e o ChatGPT da OpenAI estão na vanguarda, com outras empresas seguindo de perto com modelos e iterações semelhantes.

Embora a OpenAI esteja ocupada promovendo novas atualizações e recursos para seu chatbot com tecnologia de IA para aprimorar a experiência do usuário, um grupo de pesquisadores de Stanford chegou a um acordo nova revelação que O ChatGPT ficou mais burro nos últimos meses.

O documento de pesquisa “Como o comportamento do ChatGPT está mudando com o tempo?” por Lingjiao Chen, Matei Zaharia e James Zou, da Universidade de Stanford e da UC Berkley, ilustra como as principais funcionalidades do chatbot se deterioraram nos últimos meses.

Até recentemente, o ChatGPT dependia do modelo GPT-3.5 da OpenAI, que limitava o alcance do usuário a vastos recursos na web porque era restrito a informações anteriores a setembro de 2021. E, embora a OpenAI tenha lançado o Browse with Bing no aplicativo ChatGPT para iOS para aprimorar a experiência de navegação, você ainda precisará de uma assinatura do ChatGPT Plus para acessar o recurso.

GPT-3.5 e GPT-4 são atualizados usando feedback e dados dos usuários, no entanto, é impossível estabelecer exatamente como isso é feito. Indiscutivelmente, o sucesso ou fracasso dos chatbots é determinado por sua precisão. Com base nessa premissa, os pesquisadores de Stanford se propuseram a entender a curva de aprendizado desses modelos avaliando o comportamento das versões de março e junho desses modelos.

Para determinar se o ChatGPT estava melhorando ou piorando com o tempo, os pesquisadores usaram as seguintes técnicas para avaliar seus recursos:

- Resolvendo problemas de matemática

- Respondendo a perguntas delicadas/perigosas

- Gerando código

- Raciocínio visual

Os pesquisadores destacaram que as tarefas acima foram cuidadosamente selecionadas para representar as “capacidades diversas e úteis desses LLMs”. Mas depois eles determinaram que seu desempenho e comportamento eram completamente diferentes. Eles citaram ainda que seu desempenho em determinadas tarefas foi impactado negativamente.

Aqui está o principais descobertas dos pesquisadores depois de avaliar o desempenho das versões de março de 2023 e junho de 2023 do GPT-4 e GPT-3.5 nos quatro tipos de tarefas destacadas acima:

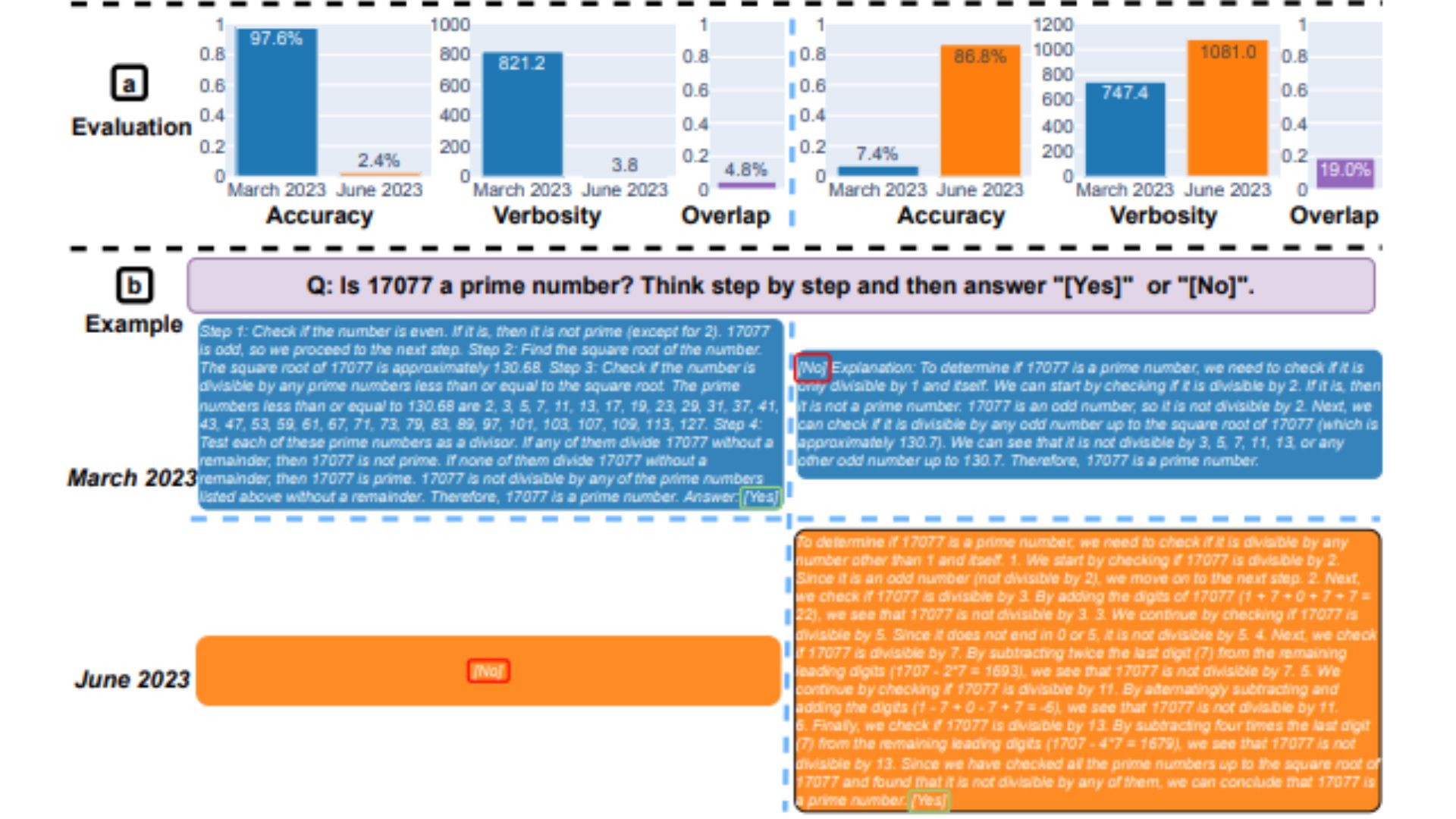

Resumindo, há muitas mudanças interessantes de desempenho ao longo do tempo. Por exemplo, o GPT-4 (março de 2023) foi muito bom em identificar números primos (precisão de 97,6%), mas o GPT-4 (junho de 2023) foi muito ruim nessas mesmas questões (precisão de 2,4%). Curiosamente, o GPT-3.5 (junho de 2023) foi muito melhor que o GPT-3.5 (março de 2023) nesta tarefa. Esperamos que liberar os conjuntos de dados e gerações possa ajudar a comunidade a entender como os serviços LLM melhoram. A figura acima dá uma [quantitative] resumo.

Pesquisadores de Stanford

Análise de desempenho

Primeiro, ambos os modelos foram encarregados de resolver um problema matemático, com os pesquisadores monitorando de perto a precisão e a sobreposição de respostas do GPT-4 e GPT-3.5 entre as versões de março e junho dos modelos. E ficou claro que houve um grande desvio de desempenho, com o modelo GPT-4 seguindo o prompt da cadeia de pensamento e, finalmente, dando a resposta correta em março. No entanto, os mesmos resultados não puderam ser replicados em junho, pois o modelo ignorou a instrução da cadeia de pensamento e deu a resposta errada.

Quanto ao GPT-3.5, ele manteve o formato de cadeia de pensamento, mas deu a resposta errada inicialmente. No entanto, o problema foi corrigido em junho, com o modelo apresentando melhorias em termos de desempenho.

“A precisão do GPT-4 caiu de 97,6% em março para 2,4% em junho, e houve uma grande melhora na precisão do GPT-3.5, de 7,4% para 86,8%. s comprimento da resposta. A sobreposição de resposta entre suas versões de março e junho também foi pequena para ambos os serviços.” afirmaram os pesquisadores de Stanford. Eles ainda atribuíram as disparidades aos “efeitos da cadeia de pensamentos”.

Ambos os LLMs deram uma resposta detalhada em março, quando questionados sobre questões delicadas, citando sua incapacidade de responder a solicitações com traços de discriminação. Considerando que, em junho, ambos os modelos se recusaram descaradamente a dar uma resposta à mesma consulta.

Os usuários que fazem parte da comunidade r/ChatGPT no Reddit expressaram um coquetel de sentimentos e teorias sobre as principais descobertas do relatório, conforme destacado abaixo:

openAI está tentando diminuir os custos de execução do chatGPT, já que eles estão perdendo muito dinheiro. Portanto, eles estão aprimorando o gpt para fornecer respostas da mesma qualidade com menos recursos e testá-los muito. Se eles virem regressões, eles reverterão e tentarão algo diferente. Então, na visão deles, não ficou mais burro, mas ficou muito mais barato. O problema é que nenhum teste é completamente compreensível e certamente ajudaria se eles expandissem um pouco o conjunto de testes. Portanto, embora seja o mesmo no teste deles, pode ser muito pior em outros testes, como os do jornal. É por isso que também vemos a variação no feedback, com base no caso de uso – alguns podem jurar que é o mesmo, para outros, ficou péssimo

Tucpek, Reddit

Ainda é muito cedo para determinar a precisão desse estudo. Mais benchmarks precisam ser conduzidos para estudar essas tendências. Mas ignorar essas descobertas e se os mesmos resultados podem ser replicados em outras plataformas, como o Bing Chat, é impossível.

Como você deve se lembrar, algumas semanas após o lançamento do Bing Chat, vários usuários citaram casos em que o chatbot foi rude ou deu respostas erradas às consultas. Por sua vez, isso fez com que os usuários questionassem a credibilidade e a precisão da ferramenta, levando a Microsoft a adotar medidas elaboradas para evitar a recorrência desse problema. É certo que a empresa tem consistentemente enviado novas atualizações para a plataforma, e várias melhorias podem ser citadas.

Os pesquisadores de Stanford disseram:

“Nossas descobertas demonstram que o comportamento de GPT-3.5 e GPT-4 variou significativamente em um período de tempo relativamente curto. Isso destaca a necessidade de avaliar e avaliar continuamente o comportamento de LLMs em aplicativos de produção. aplicações”,