Nos últimos meses, houve uma onda de evidências anedóticas e murmúrios gerais sobre um declínio na qualidade das respostas do ChatGPT. Uma equipe de pesquisadores de Stanford e UC Berkeley decidiu determinar se realmente houve degradação e apresentou métricas para quantificar a escala de mudança prejudicial. Para encurtar a história, o mergulho na qualidade do ChatGPT certamente não foi imaginado.

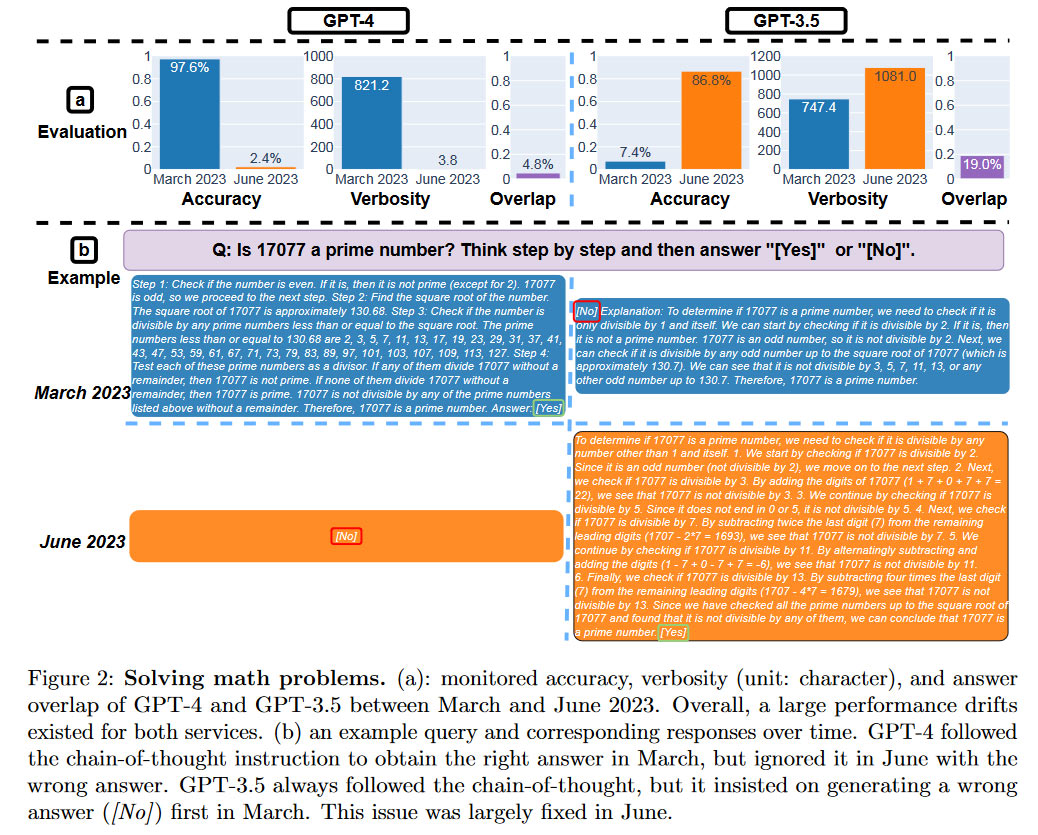

Três acadêmicos ilustres, Matei Zaharia, Lingjiao Chen e James Zou, estavam por trás do trabalho de pesquisa recentemente publicado Como o comportamento do ChatGPT está mudando com o tempo? (PDF) Hoje cedo, o professor de Ciência da Computação da UC Berkeley, Zaharia, foi ao Twitter para compartilhe as descobertas. Ele destacou surpreendentemente que “a taxa de sucesso do GPT -4 em ‘esse número é primo? pense passo a passo’ caiu de 97,6% para 2,4% de março a junho.”

GPT-4 tornou-se geralmente disponível cerca de duas semanas atrás e foi defendido pela OpenAI como seu modelo mais avançado e capaz. Ele foi rapidamente lançado para desenvolvedores de API pagos, alegando que poderia alimentar uma variedade de novos produtos inovadores de IA. Portanto, é triste e surpreendente que o novo estudo ache tão carente de respostas de qualidade diante de algumas perguntas bastante diretas.

Já demos um exemplo da superlativa taxa de falha do GPT-4 nas consultas de números primos acima. A equipe de pesquisa projetou tarefas para medir os seguintes aspectos qualitativos dos modelos de linguagem grandes (LLMs) subjacentes do ChatGPT, GPT-4 e GPT-3.5. As tarefas se enquadram em quatro categorias, medindo uma gama diversificada de habilidades de IA e sendo relativamente simples de avaliar quanto ao desempenho.

- Resolvendo problemas de matemática

- Respondendo a perguntas delicadas

- Geração de código

- Raciocínio visual

Uma visão geral do desempenho dos Open AI LLMs é fornecida no gráfico abaixo. Os pesquisadores quantificaram os lançamentos de GPT-4 e GPT-3.5 em seus lançamentos de março de 2023 e junho de 2023.

É claramente ilustrado que o “mesmo” serviço LLM responde a consultas de maneira bastante diferente ao longo do tempo. Observam-se diferenças significativas neste período relativamente curto. Ainda não está claro como esses LLMs são atualizados e se mudanças para melhorar alguns aspectos de seu desempenho podem impactar negativamente outros. Veja o quanto ‘pior’ a versão mais recente do GPT-4 é comparada à versão de março em três categorias de teste. Ele só ganha uma pequena margem no raciocínio visual.

Alguns podem não se incomodar com a qualidade variável observada nas ‘mesmas versões’ desses LLMs. No entanto, os pesquisadores observam: “Devido à popularidade do ChatGPT, tanto o GPT-4 quanto o GPT-3.5 foram amplamente adotados por usuários individuais e várias empresas”. Portanto, não é impossível que algumas informações geradas pela GPT possam afetar seu vida.

Os pesquisadores expressaram sua intenção de continuar avaliando as versões do GPT em um estudo mais longo. Talvez a Open AI devesse monitorar e publicar suas próprias verificações de qualidade regulares para seus clientes pagantes. Se não puder ser mais claro sobre isso, pode ser necessário que organizações empresariais ou governamentais verifiquem algumas métricas básicas de qualidade para esses LLMs, que podem ter impactos comerciais e de pesquisa significativos.

Não, não tornamos o GPT-4 mais burro. Muito pelo contrário: tornamos cada nova versão mais inteligente do que a anterior. Hipótese atual: Ao usá-lo com mais intensidade, você começa a perceber problemas que não via antes.13 de julho de 2023

A tecnologia de IA e LLM não é estranha a problemas surpreendentes, e com as alegações de furto de dados do setor e outras relações públicas pântanosatualmente parece ser a mais recente fronteira do ‘oeste selvagem’ na vida e no comércio conectados.